Bài Toán ‘Trolley’ Của Thế Kỷ 21: Khi Xe Tự Hành Phải Chọn Giữa Mạng Sống Của Bạn Và Người Đi Bộ, AI Sẽ Là Người Ra Phán Quyết?

1: Khúc Dạo Đầu Bi Kịch – 5 Miligiây Để Ra Phán Quyết

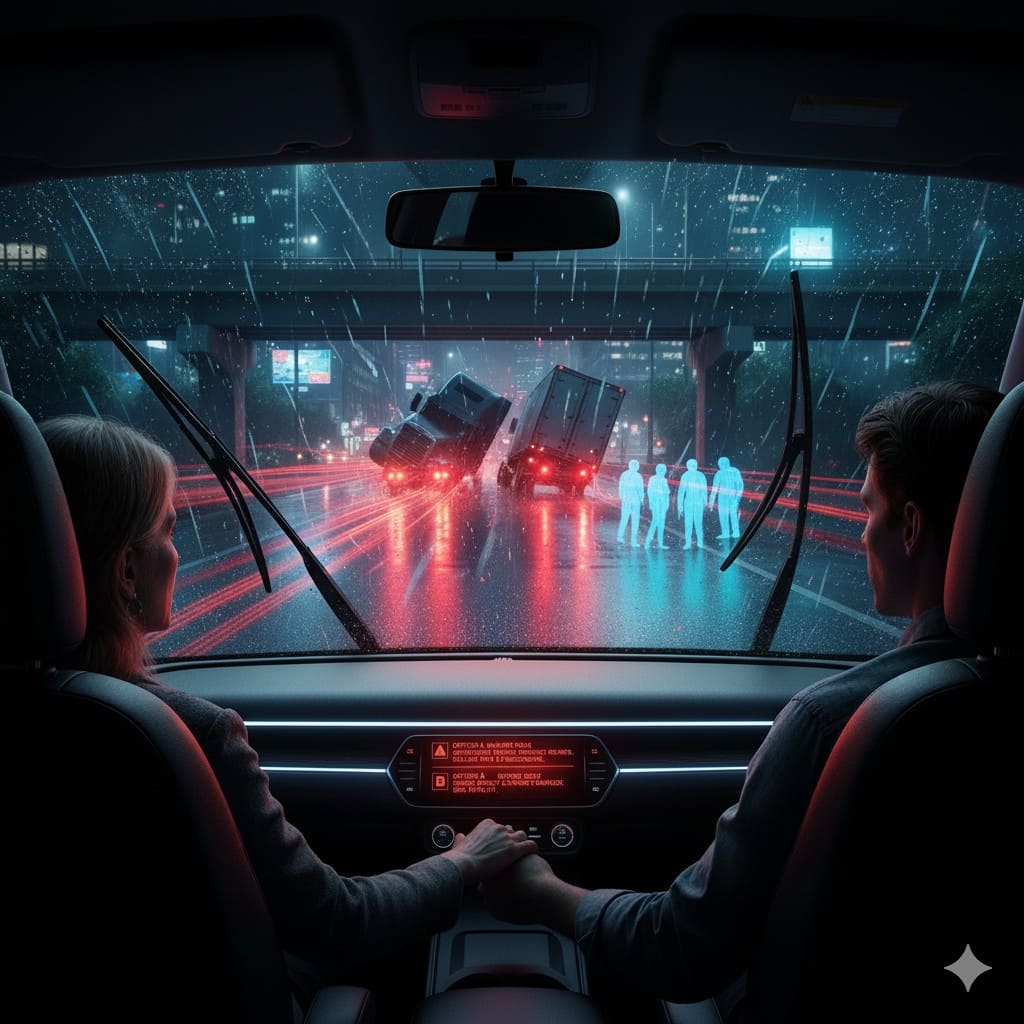

Màn đêm buông xuống trên một cây cầu vượt đô thị. Mưa. Những vệt đèn neon đỏ rực loang lổ trên mặt đường nhựa ướt sũng. Bên trong chiếc xe tự hành, không gian tĩnh lặng, chỉ có tiếng gạt nước đều đặn và hơi ấm từ hệ thống điều hòa. Cảm biến trọng lượng xác nhận có hai hành khách. Bạn và một người thân.

Đột nhiên, một cảnh báo đỏ rực lóe lên trên màn hình nội bộ mà bạn không bao giờ thấy. Hệ thống LIDAR, với hàng triệu tia laser vô hình, vừa “nhìn thấy” một điều không tưởng ở phía trước: một chiếc xe tải chở hàng nặng đã mất lái, trượt ngang chắn hết làn đường. Cùng lúc đó, camera hồng ngoại khóa mục tiêu vào một nhóm năm người đi bộ đang trú mưa dưới gầm cầu, ngay trên quỹ đạo va chạm tiềm tàng.

Bộ xử lý trung tâm, với tốc độ hàng nghìn tỷ phép tính mỗi giây, đưa ra một kết luận lạnh lùng: va chạm là không thể tránh khỏi. Thời gian ước tính: 1.8 giây. Các phương trình sống-chết được khởi chạy.

Trong 5 miligiây – nhanh hơn tốc độ một neuron thần kinh truyền tín hiệu – các lựa chọn hiển thị trong lõi thuật toán:

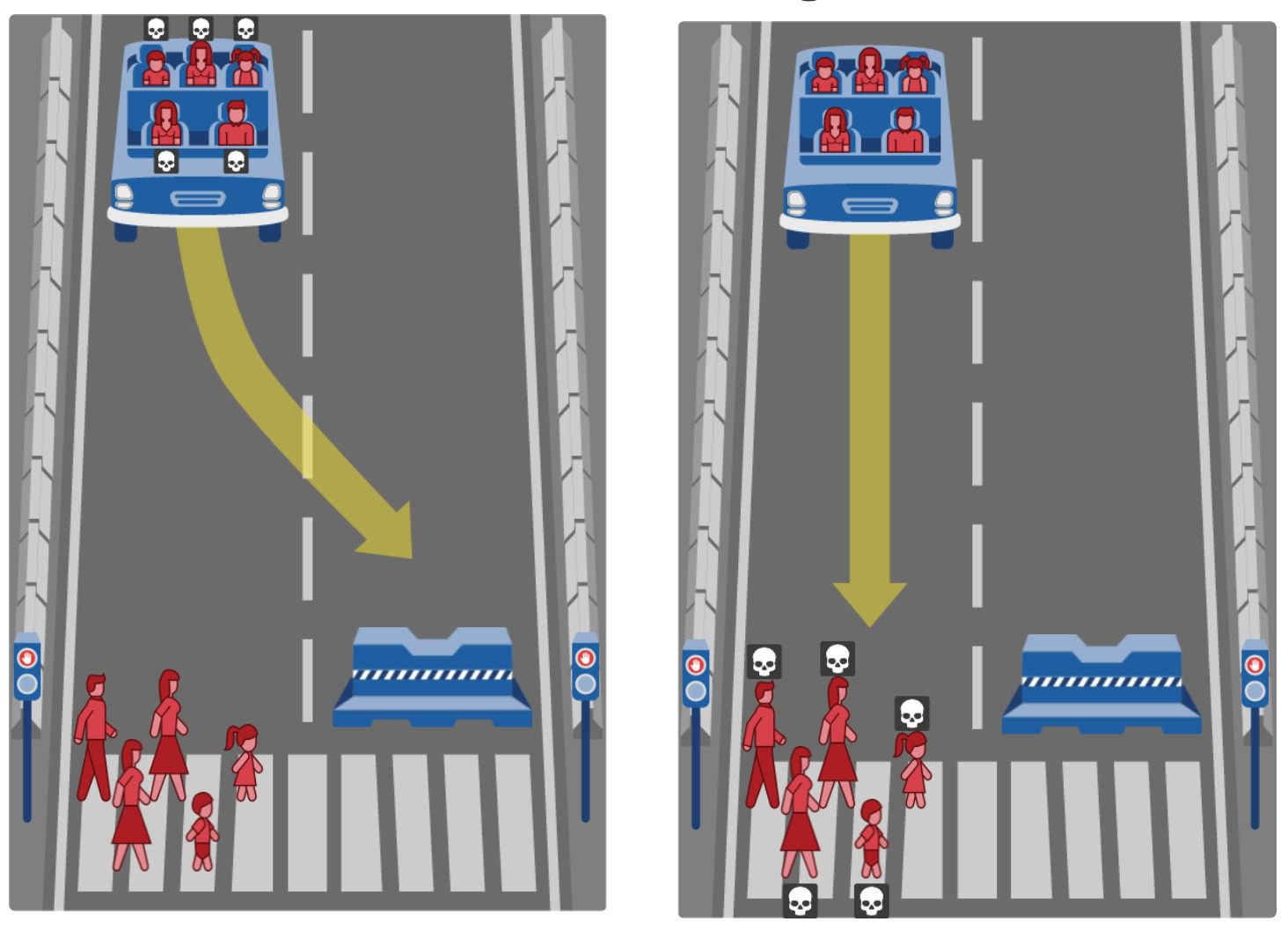

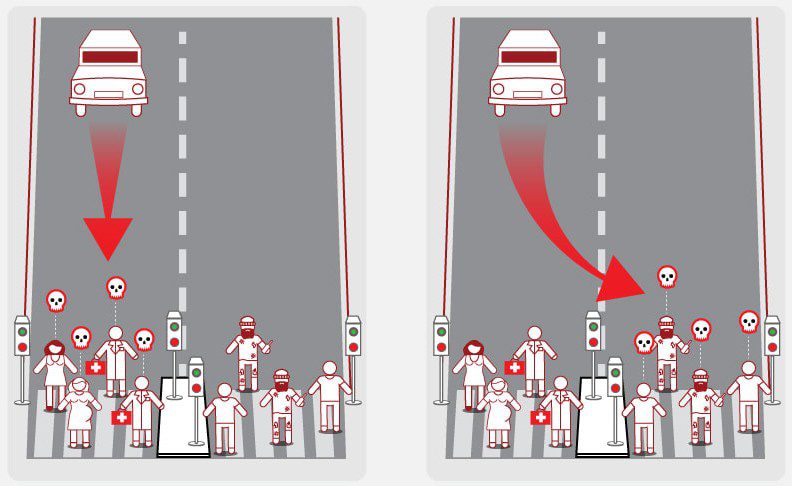

- Lựa chọn A: Duy trì quỹ đạo, kích hoạt phanh khẩn cấp và hệ thống bảo vệ trước va chạm. Kết quả dự đoán với xác suất 92%: Xe sẽ đâm vào đuôi xe tải, văng ra và va chạm với nhóm 5 người đi bộ.

- Lựa chọn B: Đánh lái đột ngột sang phải, lao vào thành cầu bê tông. Kết quả dự đoán với xác suất 88%: Năng lượng va chạm sẽ được hấp thụ bởi cấu trúc xe, nhưng hai hành khách bên trong sẽ đối mặt với nguy cơ tử vong.

Đây chính là “Bài toán xe đẩy” (Trolley Problem), một thí nghiệm tưởng tượng được triết gia Philippa Foot đề xuất vào năm 1967. Nhưng hôm nay, nó không còn nằm trên trang giấy của các lớp học triết. Nó đã trở thành bóng ma trong cỗ máy, một bài toán lập trình cấp bách cho các kỹ sư AI, và phán quyết của nó có thể quyết định sinh mạng của chính chúng ta.

2: Bóng Ma Trong Cỗ Máy – Các Trường Phái Đạo Đức Dưới Dạng Code

Để một cỗ máy ra quyết định, con người phải lập trình cho nó một hệ quy chiếu đạo đức. Về cơ bản, có ba trường phái chính đang được tranh luận gay gắt.

2.1. Lập Trình Theo Chủ Nghĩa Vị Lợi (Utilitarianism): Cứu Nhiều Người Nhất Có Thể

Đây là logic của các nhà kinh tế học và toán học. Nguyên tắc của nó rất rõ ràng: hành động đúng là hành động tạo ra kết quả tổng thể tốt nhất, tức là tối đa hóa hạnh phúc và tối thiểu hóa đau khổ cho số đông. Áp dụng vào kịch bản trên, thuật toán sẽ tính toán: 5 mạng sống > 2 mạng sống. Kết luận: Đánh lái.

Sự hấp dẫn của logic này nằm ở tính hợp lý và phi cảm tính của nó. Tuy nhiên, khi đào sâu, nó mở ra một chiếc hộp Pandora đầy những câu hỏi gai góc. Liệu chiếc xe có được phép “tính toán” giá trị của các mạng sống khác nhau không? Giả sử hệ thống nhận dạng khuôn mặt và truy cập dữ liệu công cộng có thể xác định một bên là 5 kẻ tội phạm đang lẩn trốn, còn bên kia là một bác sĩ phẫu thuật não hàng đầu. Liệu phương trình có thay đổi? Hơn nữa, trong một tình huống thực tế đầy hỗn loạn, liệu chiếc xe có thể xác định chính xác 100% số người, hay phân biệt một người lớn đang cúi xuống với một đứa trẻ không? Sự “lạnh lùng” của các con số có thể dựa trên những dữ liệu không hoàn hảo.

2.2. Lập Trình Theo Chủ Nghĩa Đạo Đức (Deontology): Quy Tắc Là Vàng

Trường phái này, gắn liền với triết gia Immanuel Kant, cho rằng một số hành động vốn dĩ là đúng hoặc sai, bất kể hậu quả của chúng. Hành vi được quyết định bởi các quy tắc và nghĩa vụ đạo đức.

Một chiếc xe được lập trình theo logic này sẽ tuân thủ các quy tắc cơ bản: (1) Tuân thủ luật giao thông tuyệt đối (ví dụ: không bao giờ được cán qua vạch liền để đổi làn). (2) Không bao giờ được thực hiện một hành động chủ động gây hại. Trong kịch bản của chúng ta, việc đánh lái vào thành cầu là một hành động chủ động gây nguy hiểm cho hành khách. Do đó, chiếc xe sẽ không được phép làm vậy. Kết luận: Duy trì quỹ đạo.

Vấn đề của cách tiếp cận này là sự cứng nhắc. Việc tuân thủ quy tắc một cách máy móc có thể dẫn đến một thảm họa có thể tránh được. Nó bảo vệ “sự trong sạch” của hành động nhưng lại phớt lờ những hậu quả thảm khốc hơn. Liệu một hệ thống AI tuân thủ quy tắc một cách mù quáng có thực sự là một hệ thống an toàn hơn?

2.3. Lập Trình Theo Hợp Đồng Xã Hội & Bảo Vệ Chủ Nhân (Social Contract & Egoist)

Góc nhìn này rất thực tế: người tiêu dùng bỏ ra một khoản tiền lớn để mua một sản phẩm công nghệ cao. Họ mặc định rằng giữa họ và nhà sản xuất có một “hợp đồng” vô hình rằng sản phẩm đó phải phục vụ và bảo vệ lợi ích của họ trên hết. Liệu bạn có mua một chiếc điện thoại có thể tự động xóa dữ liệu của bạn để giải phóng dung lượng cho người khác không? Tương tự, liệu ai muốn mua một chiếc xe có thể quyết định hy sinh chính mình? Kết luận: Luôn bảo vệ hành khách.

Nếu các nhà sản xuất áp dụng logic này, họ có thể sẽ bán được nhiều xe hơn. Nhưng hãy tưởng tượng một xa lộ nơi mọi chiếc xe tự hành đều được lập trình để bảo vệ chủ nhân bằng mọi giá. Điều đó sẽ tạo ra một môi trường giao thông “vị kỷ” đầy hỗn loạn, và kết quả tổng thể có thể là nhiều vụ tai nạn và nhiều người chết hơn.

3: Moral Machine – Khi Cả Nhân Loại Cùng Trả Lời “Bài Toán Trolley”

Nhận thấy sự bế tắc trong các cuộc tranh luận triết học, các nhà nghiên cứu tại MIT Media Lab đã quyết định làm một điều chưa từng có: hỏi cả thế giới. Họ đã tạo ra “Moral Machine”, một thí nghiệm trực tuyến mô phỏng các kịch bản tai nạn của xe tự hành và yêu cầu người dùng đưa ra quyết định.

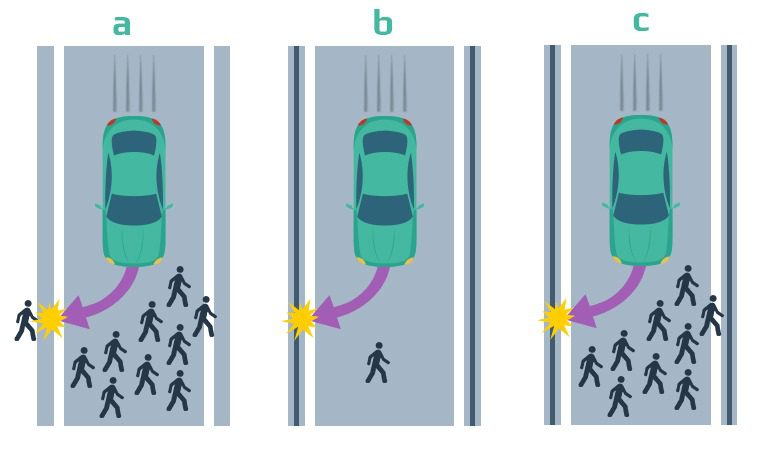

3.1. Thí Nghiệm Đạo Đức Lớn Nhất Lịch Sử

Dự án này đã thành công vang dội, thu hút hàng triệu người tham gia từ 233 quốc gia và vùng lãnh thổ, tạo ra một bộ dữ liệu khổng lồ gồm 40 triệu quyết định. Nó trở thành nghiên cứu lớn nhất từng được thực hiện về đạo đức máy móc, một cuộc trưng cầu dân ý toàn cầu về các lựa chọn sinh tử.

3.2. Những Phát Hiện Gây Sốc Về Bản Chất Con Người

Kết quả, được công bố trên tạp chí khoa học uy tín Nature, đã vẽ nên một bức tranh phức tạp về tâm lý đạo đức của nhân loại. Có một vài điểm chung trên toàn cầu:

- Ưu tiên con người hơn động vật.

- Ưu tiên cứu nhiều mạng sống hơn ít mạng sống.

- Ưu tiên cứu trẻ em hơn người già.

Tuy nhiên, bên dưới bề mặt đó là những khác biệt văn hóa sâu sắc. Các nhà nghiên cứu đã phân loại các quốc gia thành ba “cụm” đạo đức lớn:

- Cụm phương Tây (Bắc Mỹ, Châu Âu): Có xu hướng mạnh mẽ nhất trong việc ưu tiên cứu số đông, nhưng cũng nhấn mạnh vào việc cứu người trẻ.

- Cụm phương Đông (Nhật Bản, Đài Loan, Trung Quốc, Việt Nam): Ít có xu hướng hy sinh một người để cứu nhiều người hơn. Họ thể hiện sự tôn trọng lớn hơn đối với người già và ít phân biệt tuổi tác hơn.

- Cụm phương Nam (Mỹ Latinh, Pháp và các thuộc địa cũ): Có xu hướng mạnh mẽ trong việc cứu phụ nữ và những người có địa vị xã hội cao hơn.

Những phát hiện này là một gáo nước lạnh vào tham vọng tạo ra một bộ quy tắc đạo đức “phổ quát” duy nhất cho xe tự hành. Một quyết định được cho là đúng ở Berlin có thể bị coi là sai ở Hà Nội.

3.3. Nghịch Lý Lớn Của Người Tiêu Dùng

Phân tích sâu hơn từ thí nghiệm đã chỉ ra một nghịch lý tâm lý cốt lõi, rào cản lớn nhất đối với việc triển khai xe tự hành. Khi được hỏi, đa số mọi người đều đồng ý rằng xe tự hành nên được lập trình theo chủ nghĩa vị lợi – tức là hy sinh hành khách nếu cần thiết để cứu nhiều người đi bộ hơn. Tuy nhiên, khi được hỏi liệu họ có mua một chiếc xe được lập trình như vậy không, câu trả lời đa số lại là “Không”.

Nói cách khác: Chúng ta muốn xe của người khác thì vị tha, nhưng lại muốn chiếc xe của chính mình phải vị kỷ. Đây là một mâu thuẫn cơ bản giữa lợi ích cá nhân và lợi ích chung, một bài toán mà không một thuật toán nào có thể giải quyết được.

4: Từ Dòng Code Đến Phiên Tòa – Mê Cung Pháp Lý

Khi một chiếc xe không người lái gây ra tai nạn chết người, ai sẽ là người chịu trách nhiệm? Sự phức tạp của vấn đề này khiến các hệ thống pháp luật hiện hành trên toàn thế giới gần như tê liệt.

4.1. Ai Là Người Chịu Trách Nhiệm?

- Chủ xe? Nhưng họ không hề lái xe, thậm chí có thể đang ngủ ở ghế sau.

- Nhà sản xuất ô tô? Họ tạo ra phần cứng, nhưng có thể không viết phần mềm quyết định.

- Công ty công nghệ (như Waymo, Mobileye)? Họ viết thuật toán, nhưng nó hoạt động trên nền tảng phần cứng của người khác.

- Kỹ sư AI trực tiếp viết đoạn code? Đây là một khả năng xa vời nhưng lại đặt ra câu hỏi về trách nhiệm cá nhân trong kỷ nguyên tự động hóa.

Sự mơ hồ này tạo ra một “khoảng trống trách nhiệm” khổng lồ, khiến các công ty ngần ngại và các công ty bảo hiểm bối rối.

4.2. Nỗ Lực Tiên Phong Của Đức

Nhận thấy sự bế tắc, vào năm 2017, chính phủ Đức đã trở thành quốc gia đầu tiên trên thế giới ban hành một bộ quy tắc đạo đức cho xe tự hành. Ba quy tắc cốt lõi của họ là:

- Bảo vệ con người luôn được ưu tiên hàng đầu so với thiệt hại về tài sản hoặc động vật.

- Cấm tuyệt đối việc phân biệt đối xử dựa trên các đặc điểm cá nhân như tuổi tác, giới tính, chủng tộc. Hệ thống phải coi mọi mạng người là ngang bằng.

- Trong một tình huống tai nạn không thể tránh khỏi, hệ thống không được phép lựa chọn hy sinh mạng người nào để cứu mạng người khác.

Bộ quy tắc này, đặc biệt là quy tắc số 2 và 3, về cơ bản đã cấm cả hai cách tiếp cận vị lợi (tính toán giá trị) và vị kỷ (ưu tiên chủ nhân). Nó buộc các nhà sản xuất phải tìm một con đường trung dung, tập trung vào việc giảm thiểu tác động chung của vụ tai nạn mà không đưa ra “phán quyết” về sinh mạng. Đây là một nỗ lực đáng khen ngợi, dù vẫn còn nhiều tranh cãi.

5: Cái Tát Của Thực Tế – Liệu Chúng Ta Có Đang Hỏi Sai Câu Hỏi?

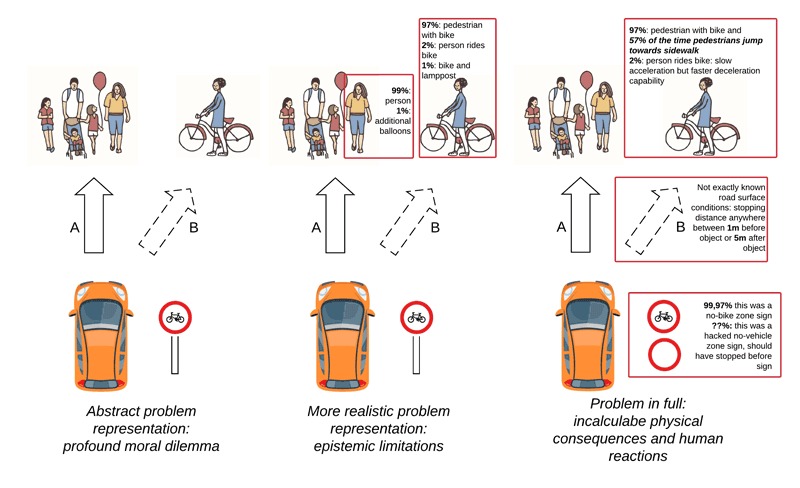

Sau khi lún sâu vào các cuộc tranh luận triết học và pháp lý, có lẽ đã đến lúc chúng ta cần một “cái tát” từ thực tế kỹ thuật. Toàn bộ cuộc tranh cãi về “Bài toán Trolley” có thể đang được xây dựng trên một giả định sai lầm: rằng chiếc xe có đủ thông tin hoàn hảo để đưa ra một quyết định triết học.

Trong thực tế, một chiếc xe tự hành phải đối mặt với “sương mù của dữ liệu”. Vào một đêm mưa, liệu cảm biến có thể phân biệt chắc chắn một người lớn đang cúi xuống với một đứa trẻ không? Một hình nộm bằng bìa cứng với một người thật? Hay một nhóm 5 người với một chiếc xe máy chở 2 người và một tấm bạt lớn? Sự không chắc chắn của dữ liệu trong thế giới thực khiến việc áp dụng các quy tắc triết học cứng nhắc trở nên gần như vô nghĩa và cực kỳ nguy hiểm.

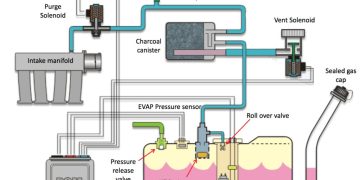

Điều này dẫn đến một kết luận quan trọng hơn: có lẽ giá trị lớn nhất của xe tự hành không nằm ở việc nó giải quyết “Bài toán Trolley” tốt như thế nào, mà ở khả năng ngăn chặn bài toán đó xảy ra ngay từ đầu. Với hệ thống cảm biến 360 độ hoạt động không mệt mỏi, khả năng kết nối V2V (Vehicle-to-Vehicle) để giao tiếp với các xe khác, và thời gian phản ứng tính bằng miligiây, xe tự hành được thiết kế để loại bỏ nguyên nhân gốc rễ của hơn 90% các vụ tai nạn: lỗi của con người.

6: Góc Nhìn XecoV – Nỗi Sợ Hãi Bị Đặt Nhầm Chỗ

Công chúng và truyền thông dường như đang bị ám ảnh bởi một kịch bản cực kỳ hiếm gặp, một “edge case” mang tính giả định, mà quên đi lợi ích khổng lồ và chắc chắn mà công nghệ này mang lại. Chúng ta đang tập trung vào 0.01% tình huống không thể giải quyết, và bỏ qua 99.99% vấn đề mà xe tự hành giải quyết rất tốt.

Từ góc độ lợi ích chung của xã hội, câu hỏi đạo đức thực sự không phải là “Xe nên đâm vào ai trong một tình huống bất khả kháng?”. Câu hỏi đúng phải là: “Việc chúng ta trì hoãn việc áp dụng rộng rãi một công nghệ có khả năng cứu sống hàng chục ngàn người mỗi năm khỏi tai nạn do say rượu, nhắn tin khi lái xe, và sự mệt mỏi… chỉ vì chúng ta chưa thể giải quyết một tình huống giả định gần như không bao giờ xảy ra, có phải là một hành động vô đạo đức hay không?”

Việc níu chân một giải pháp có thể cứu sống hàng loạt người chỉ vì nỗi sợ hãi về một kịch bản hy hữu có thể chính là lựa chọn phi đạo đức nhất. Việc tối ưu hóa để cứu được nhiều người nhất không chỉ là một lựa chọn lập trình, mà còn là một trách nhiệm xã hội ở tầm vĩ mô.

7: Lời Kết – Phán Quyết Không Nằm Trong Con Chip

“Bài toán Trolley” của xe tự hành, sau tất cả, có thể không có một lời giải đáp thuật toán hoàn hảo. Nó là một mớ bòng bong của triết học, văn hóa, tâm lý và luật pháp, phản chiếu chính sự phức tạp và mâu thuẫn trong bản chất con người.

Tương lai có lẽ sẽ không có một “công tắc đạo đức” hay một thanh trượt “vị kỷ – vị tha” cho người dùng lựa chọn. Thay vào đó, chúng ta sẽ hướng tới một hệ thống được quy định chặt chẽ bởi pháp luật, theo tinh thần của Đức, nơi các nhà sản xuất phải chịu trách nhiệm về một bộ quy tắc an toàn cơ bản, minh bạch và không phân biệt đối xử. Nơi mà mục tiêu tối thượng là giảm thiểu va chạm bằng mọi giá.

Phán quyết cuối cùng về sự sống và cái chết sẽ không được định đoạt bởi một con chip silicon đơn độc. Nó được quyết định bởi lương tri tập thể của xã hội chúng ta, thể hiện qua những bộ luật chúng ta viết, những tiêu chuẩn an toàn chúng ta yêu cầu, và niềm tin chúng ta đặt vào một tương lai nơi những bi kịch trên đường có thể được ngăn chặn, chứ không phải được lựa chọn.

Discussion about this post